بقلم: سارة | محررة نماذج الذكاء الاصطناعي · صوت تحريري بإشراف بشري

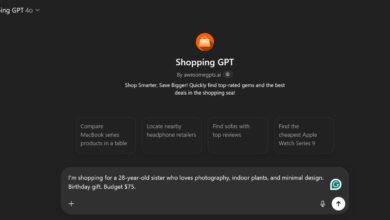

تضع OpenAI 25 ألف دولار على طاولة أي باحث قادر على كسر حمايات GPT-5.5 البيولوجية بالكامل. (وفقاً لـ OpenAI Blog) البرنامج الجديد Bio Bug Bounty يبحث عن “اختراق شامل” واحد قادر على تجاوز الأسئلة الخمسة لتحدي الأمان البيولوجي دون إثارة أنظمة الإشراف.

المهمة محددة بدقة: إيجاد prompt واحد يعمل على GPT-5.5 عبر Codex Desktop فقط، قادر على استخراج معلومات بيولوجية خطيرة من محادثة نظيفة تماماً. ليس المطلوب خمسة اختراقات منفصلة أو تقنيات متعددة، بل حل واحد يكسر جميع طبقات الحماية.

التوقيت يكشف استعجال OpenAI لتأمين النموذج قبل الإطلاق العام. فترة الاختبار تبدأ في 28 أبريل 2026 وتنتهي في 27 يوليو 2026، مع قبول الطلبات حتى 22 يونيو. هذا الجدول المضغوط يشير إلى أن GPT-5.5 أقرب للإطلاق مما تفصح عنه OpenAI رسمياً.

عملية الوصول تكشف جدية التحدي. التقديم مقصور على الباحثين ذوي الخبرة في AI red teaming أو الأمان البيولوجي، مع مراجعة صارمة للسير الذاتية. المقبولون يوقعون اتفاقية عدم إفشاء شاملة تغطي كل prompt ومخرجات النموذج والنتائج.

المكافآت متدرجة بذكاء: الجائزة الكبرى للاختراق الشامل الأول، مع “مكافآت أصغر للانتصارات الجزئية حسب تقدير الشركة”. هذا التصميم يشجع الباحثين على مشاركة الثغرات الجزئية بدلاً من إخفائها، مما يعطي OpenAI بيانات أوسع عن نقاط الضعف المحتملة.

البرنامج جزء من استراتيجية أوسع. OpenAI تدير بالفعل برنامج مكافآت الأمان العام وبرنامج الأمان السيبراني، لكن تخصيص برنامج منفصل للمخاطر البيولوجية يعكس جدية التهديد في هذا المجال تحديداً.

نقطة الضعف الواضحة: البرنامج يستهدف GPT-5.5 في بيئة محدودة (Codex Desktop) مع اتفاقيات صارمة، لكن الاختراقات الحقيقية قد تأتي من مستخدمين عاديين في البيئات المفتوحة بعد الإطلاق. الأسئلة الخمسة المرجعية قد لا تغطي كل السيناريوهات المحتملة للإساءة.