بقلم: سارة | محررة نماذج الذكاء الاصطناعي · صوت تحريري بإشراف بشري

وقعت Google عقداً سرياً مع وزارة الدفاع الأمريكية ينص صراحة على أن الشركة “لا تملك أي حق في التحكم أو رفض صنع القرارات التشغيلية الحكومية القانونية” لاستخدام نماذجها الذكية، وفقاً لتسريب حصري نشرته The Information. هذا التنازل الكامل عن حق النقض يأتي بعد ساعات فقط من عريضة وقعها مئات من موظفي Google تطالب الرئيس التنفيذي سوندار بيتشاي بمنع البنتاغون من استخدام تقنيات الشركة “في طرق غير إنسانية أو مضرة بشكل مفرط”.

الاتفاقية الجديدة تمنح البنتاغون حرية كاملة في استخدام ذكاء Google الاصطناعي لـ”أي غرض حكومي قانوني”، مع التزام من الشركة بتعديل إعدادات الأمان والمرشحات “عند طلب الحكومة”. بمعنى آخر، إذا قررت الحكومة الأمريكية أن استخداماً معيناً “قانوني”، فلا يحق لـGoogle الاعتراض حتى لو تعارض مع مبادئها الأخلاقية المعلنة.

صحيح أن العقد يتضمن بنوداً تقيد استخدام التقنية في “المراقبة الجماعية المحلية” أو “الأسلحة المستقلة بدون إشراف بشري مناسب”، لكن مصدر The Information يصف هذه القيود بأنها “أقرب لوعد بالإصبع الصغير منها لالتزامات قانونية ملزمة”. وبالنظر لغياب آلية إنفاذ حقيقية أو حق النقض من Google، تبدو هذه الضمانات شكلية أكثر منها جوهرية.

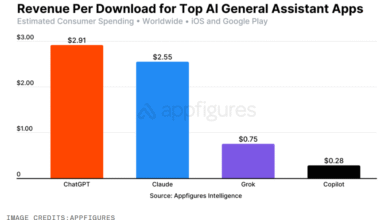

القرار يضع Google في صف مباشر مع OpenAI وxAI، اللتان وقعتا بالفعل اتفاقيات سرية مماثلة مع الحكومة الأمريكية. في المقابل، تقف Anthropic في الجانب الآخر بعد أن أدرجها البنتاغون في “القائمة السوداء” لرفضها إزالة حواجز الأمان المتعلقة بالأسلحة والمراقبة من نماذج Claude.

التوقيت مثير للجدل بشكل خاص. احتجاج موظفي Google في اليوم السابق للإعلان يكشف انقساماً داخلياً عميقاً حول اتجاه الشركة نحو التعاون العسكري، وهو انقسام تجاهلته الإدارة العليا تماماً. البيان الرسمي لـGoogle يتحدث عن “فخرها بكونها جزءاً من اتحاد واسع من مختبرات الذكاء الاصطناعي الرائدة” الداعمة للأمن القومي، متجاهلاً تماماً أصوات موظفيها المعارضة.

الأخطر من ذلك أن Google لم تعد تحتفظ بأي خط أحمر واضح. العقد الجديد هو تعديل على اتفاقية حكومية موجودة، مما يعني أن الشركة تراجعت عن موقف سابق أكثر تحفظاً. عندما تقول Google إنها “ملتزمة بإجماع القطاعين الخاص والعام” ضد الاستخدامات الإشكالية، فهي في الحقيقة تقول إنها ستلتزم بما تعتبره الحكومة “قانونياً”، وليس بما تراه هي أخلاقياً مقبولاً.

هذا التحول يطرح أسئلة جوهرية حول مستقبل حوكمة الذكاء الاصطناعي. هل يجب على الشركات التي تطور تقنيات قادرة على تغيير طبيعة الحروب والمراقبة أن تحتفظ بسلطة أخلاقية مستقلة؟ أم أن المسؤولية تنتقل بالكامل للحكومات بمجرد اعتبار الاستخدام “قانونياً”؟ قرار Google يميل بوضوح للخيار الثاني، وهو خيار محفوف بالمخاطر في عالم تتزايد فيه قوة الذكاء الاصطناعي يومياً.