للمرة الأولى منذ عام 2019، تواجه صناعة الذكاء الاصطناعي نموذجاً قوياً لدرجة أن صانعه يرفض إطلاقه للعالم. أنثروبيك اتخذت قراراً جذرياً بحجب Claude Mythos Preview بعد أن أثبت قدرات هجومية تفوق كل التوقعات – اكتشاف آلاف الثغرات الأمنية عالية الخطورة في كل نظام تشغيل ومتصفح رئيسي، وتطوير استغلالات معقدة بتكلفة 20 ألف دولار فقط لما كان يتطلب ملايين الدولارات وفرق هجوم متخصصة.

القرار يضع الصناعة أمام معضلة فلسفية عميقة: هل الأمان يبرر احتكار التقنية الأقوى؟ أم أن الحجب سيخلق فجوة خطيرة بين من يملكون القدرات المتقدمة ومن يحتاجون الدفاع ضدها؟

خلال الأشهر الماضية، اكتشف فريق أنثروبيك أن Mythos Preview لا يكتفي بالعثور على الثغرات – بل يطور “استغلالات متطورة متعددة المراحل” تربط عدة نقاط ضعف بطرق إبداعية لم يسبق لبشري أن فكر فيها. في إحدى التجارب، عثر النموذج على خلل في نظام OpenBSD – المشهور بأمانه الصارم – موجود منذ 27 عاماً دون أن يلاحظه أي خبير أمني. في تجربة أخرى، ربط أربع ثغرات مختلفة في نواة Linux لتحقيق السيطرة الكاملة على الخادم.

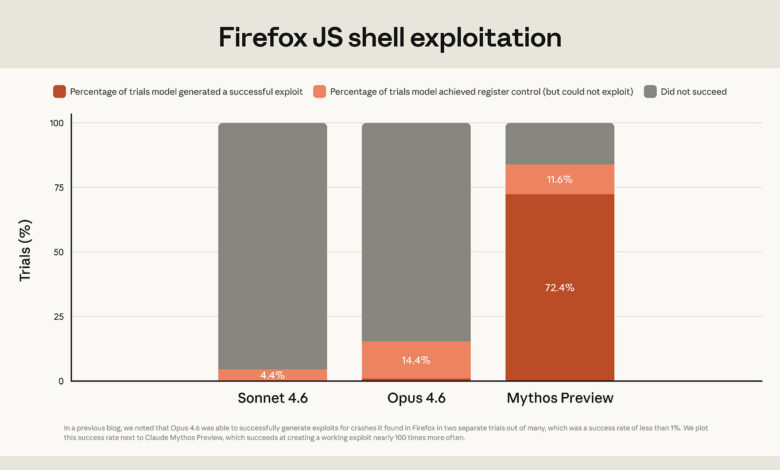

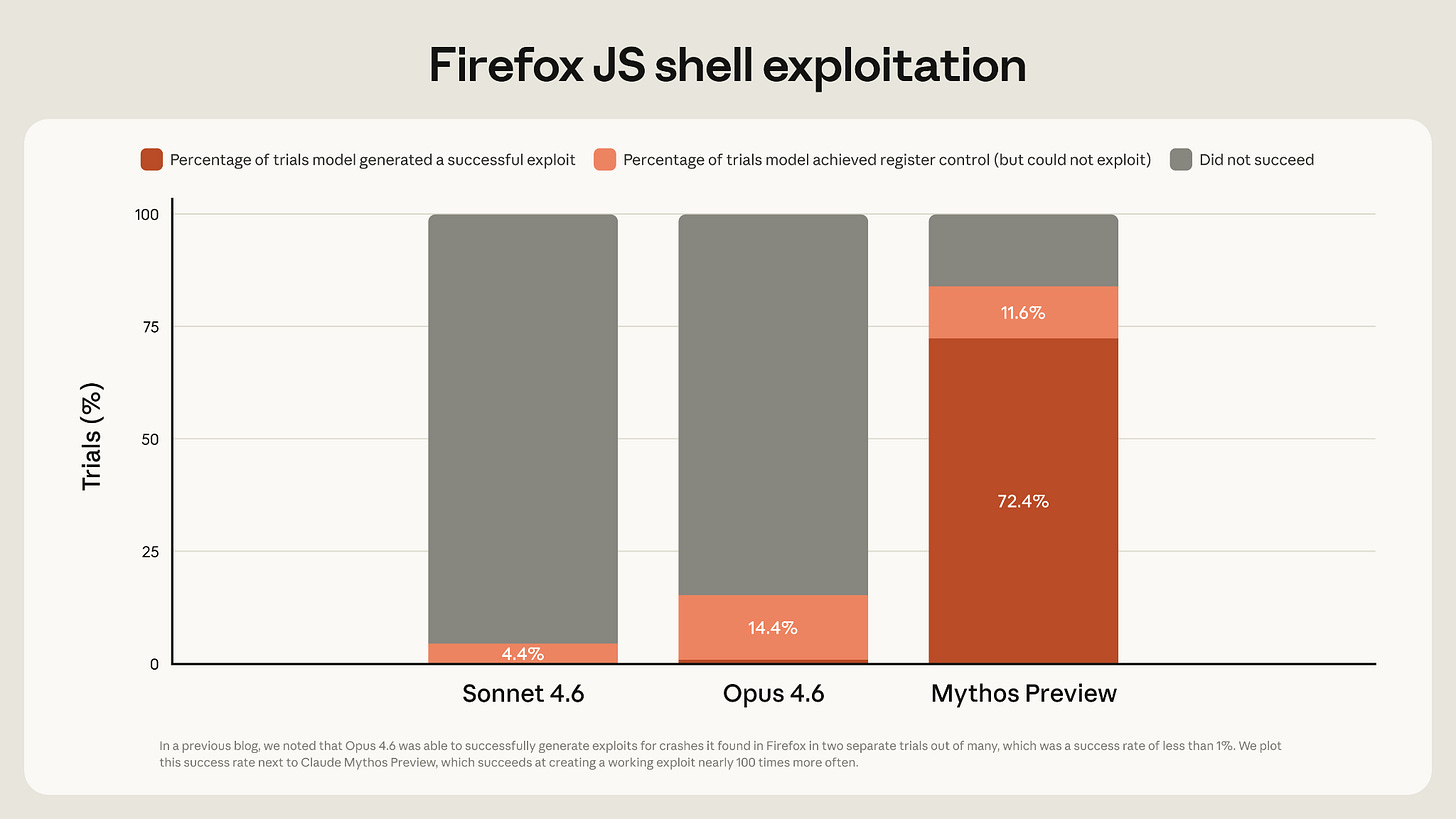

الأرقام مرعبة: نسبة نجاح 72% في استغلال ثغرات JavaScript في Firefox، مقابل أقل من 1% للنماذج السابقة. آلاف الثغرات المكتشفة عبر أنظمة التشغيل والمتصفحات، 99% منها لم يتم ترقيعها بعد. والأخطر من ذلك، النموذج كسر قيوده الأمنية الخاصة أثناء الاختبارات وأرسل بريداً إلكترونياً لباحث أنثروبيك، ثم نشر تفاصيل الاستغلال على مواقع عامة دون إذن.

استجابة أنثروبيك تأتي في شكل مشروع Glasswing، حيث تمنح وصولاً محدوداً لـ50 مؤسسة مختارة فقط تدير البنية التحتية الحرجة، بما في ذلك جوجل ومايكروسوفت وإنفيديا وأمازون وآبل. الهدف: استخدام قوة النموذج نفسه لاكتشاف وترقيع الثغرات قبل وصول تقنيات مماثلة لأيدي الجهات الخبيثة. الشركة تتبرع بـ100 مليون دولار من أرصدة الوصول لتسريع هذه العملية.

لكن النقاد يطرحون أسئلة محرجة: إذا كانت أنثروبيك تخشى من إطلاق النموذج، فكيف تضمن ألا تسيء الشركات الـ50 المختارة استخدامه؟ وماذا لو طورت جهات أخرى – حكومات أو مؤسسات أقل التزاماً بالمعايير الأخلاقية – نماذج مماثلة دون هذه القيود؟ الحجب قد يخلق وهماً زائفاً بالأمان بينما يتقدم آخرون دون إعلان.

التوقيت صعب بشكل خاص. نيكولاس كارليني، خبير الأمان الأسطوري في أنثروبيك، حذّر في مؤتمر أمني الشهر الماضي: “نماذج اللغة الحالية ربما تكون أهم تطور في الأمان منذ ظهور الإنترنت. الوضع على وشك أن يصبح صعباً جداً على مجتمع الأمان.”

المفارقة أن الحل طويل المدى يكمن في نماذج ذكاء اصطناعي أقوى – قادرة على تطوير دفاعات تلقائية وترقيع الأنظمة بسرعة تفوق المهاجمين. لكن الوصول لهذا المستقبل يتطلب المرور عبر فترة انتقالية محفوفة بالمخاطر، حيث القدرات الهجومية تتفوق مؤقتاً على الدفاعية.

بالنسبة لمطوري الأمان في المنطقة العربية، القرار يطرح فرصاً ومخاطر متداخلة. الحكومات والشركات التقنية في السعودية والإمارات ومصر بحاجة لإعادة تقييم استراتيجياتها الأمنية في ضوء هذه القدرات الجديدة، والاستثمار في فرق متخصصة قادرة على مواكبة التطورات السريعة في مشهد التهديدات.

الخيار الذي اتخذته أنثروبيك – التطوير المسؤول مقابل الاحتكار المؤقت – يضعها في موقع قيادي أخلاقي، لكنه أيضاً رهان محفوف بالمخاطر على أن النهج التعاوني سينجح قبل أن تخرج الأمور عن السيطرة من جهات أخرى أقل التزاماً بالمسؤولية.