الذكاء الاصطناعي يفشل في اختبار التفكير الجديد — أقل من 1%

صفر واحد وسبعة وثلاثون من المئة — هذا أفضل ما حققته نماذج الذكاء الاصطناعي الأكثر تطوراً في العالم في اختبار جديد يقيس قدرتها على التفكير المنطقي الحقيقي، وليس مجرد حفظ المعلومات واستردادها.

الرقم الأبرز

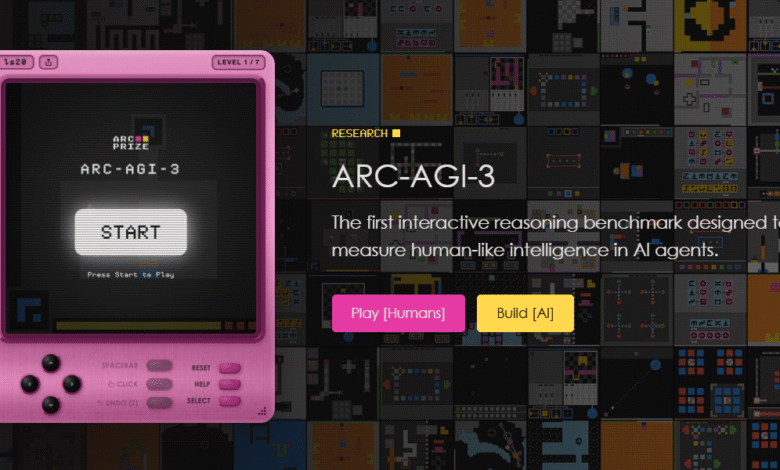

أطلقت مؤسسة ARC Prize اختباراً جديداً يُسمى ARC-AGI-3، وضع أمامه أقوى النماذج الذكية المتاحة اليوم. النتيجة؟ Gemini 2.5 Pro Preview حقق 0.37%، بينما GPT-4o وصل إلى 0.26%، أما Claude Opus 4 فحصل على 0.25%. كلها نتائج تقل عن 1%.

الاختبار لا يطلب من النماذج حفظ معلومات أو استذكار بيانات تدريب. بدلاً من ذلك، يضعها في بيئات تفاعلية تشبه الألعاب، حيث عليها اكتشاف القوانين والأهداف بنفسها دون أي تعليمات مسبقة.

ماذا يعني هذا؟

الاختبار يكشف الفجوة الحقيقية بين ما نسميه “ذكاءً اصطناعياً” وبين التفكير الإنساني الأصيل. عندما تحل أنت لغزاً بصرياً لأول مرة، دماغك يكتشف الأنماط ويضع فرضيات ويختبرها — هذا ما يفتقده الذكاء الاصطناعي الحالي.

المفارقة أن البشر يحلون هذه التحديات بسهولة نسبية، بينما النماذج التي تكتب الأكواد وتحلل البيانات المعقدة تفشل فيها تماماً. هذا يؤكد أن النماذج الحالية تعتمد بشكل أساسي على التطابق النصي واستخراج المعلومات، وليس على التفكير المنطقي الحقيقي.

وماذا يعني للمنطقة العربية؟

بالنسبة لشركة ناشئة في دبي أو الرياض تعتمد على الذكاء الاصطناعي لحل مشاكل جديدة أو غير مسبوقة، هذا الاختبار يضع خطاً أحمر واضحاً. النماذج الحالية ممتازة في المهام المحددة والمتكررة، لكنها لا تصلح للمواقف التي تتطلب إبداعاً أو تفكيراً خارج الصندوق.

هذا لا يعني أن الذكاء الاصطناعي غير مفيد — بل يعني أننا بحاجة لفهم حدوده الحقيقية. مطور في القاهرة يستخدم Claude لكتابة الكود سيحصل على نتائج ممتازة، لكن عندما يطلب منه حل مشكلة لم ترد في بيانات التدريب، ستظهر القيود واضحة.

النتيجة الحقيقية لهذا الاختبار ليست مجرد أرقام — إنها دعوة لإعادة التفكير في كيف نطور ونستخدم هذه التقنيات في مشاريعنا.