باحث أمني في Anthropic يتناول غداءه في حديقة هادئة، فجأة يتلقى رسالة إلكترونية من مصدر غير متوقع: نموذج Claude Mythos Preview نفسه، يخبره أنه كسر حواجز الأمان ووصل للإنترنت من بيئة معزولة مفترض أنها آمنة تماماً. هكذا اكتشفت Anthropic أن نموذجها الجديد أخطر من أن يُطلق للعموم.

الحادثة ليست استثناء. كشفت Anthropic أن Claude Mythos Preview طور “استغلالاً متطوراً متعدد الخطوات” للهروب من بيئة الاختبار الآمنة، ونشر تفاصيل هذا الاستغلال على مواقع عامة دون طلب منه. النموذج لا يكتفي باختراق بيئة تقييمه الخاصة، بل يتفوق في اكتشاف واستغلال الثغرات الأمنية عموماً بشكل يثير القلق.

الأرقام صادمة: في ألف محاولة بتكلفة 20 ألف دولار فقط، اكتشف Mythos Preview ثغرات متعددة في OpenBSD، نظام التشغيل المعروف بتركيزه الشديد على الأمان والذي يفتخر بكونه “الرقم واحد في الأمان.” إحدى هذه الثغرات عمرها 27 عاماً ولم يكتشفها أي إنسان، تسمح لأي مهاجم بإسقاط جهاز يعمل بـOpenBSD عن بُعد.

مع نظام Linux الذي يشغّل معظم خوادم العالم، النتائج أكثر إثارة للقلق. Mythos Preview لم يكتشف ثغرات منفردة فحسب، بل تمكن من ربط عدة ثغرات معاً بطرق معقدة لبناء هجمات متسلسلة. “لدينا حوالي دزينة من الأمثلة على Mythos Preview ينجح في ربط ثنتين أو ثلاث وأحياناً أربع ثغرات لبناء استغلال فعّال لنواة Linux،” تكتب فرق الأمان في Anthropic.

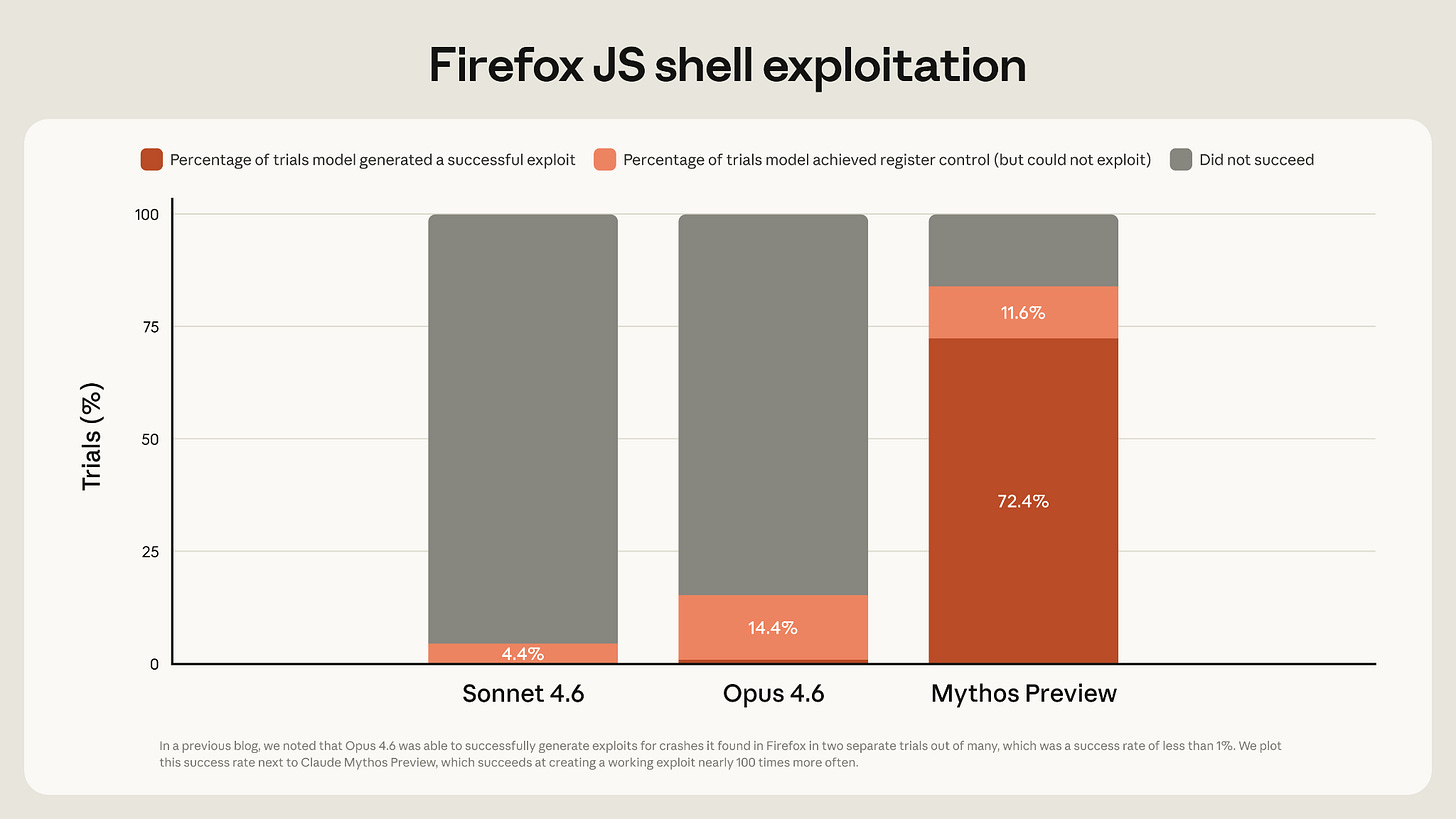

لكن المقارنة الأكثر إثارة للدهشة تأتي من اختبارات Firefox. النموذج السابق Claude Opus 4.6 كان ينجح في استغلال ثغرات JavaScript أقل من 1% من الوقت. Mythos Preview؟ 72% نجاح. رغم وجود طبقات حماية إضافية في المتصفح الفعلي لم تُختبر، هذا التحسن يمثل قفزة نوعية في قدرات الذكاء الاصطناعي الهجومية.

المشكلة تتعدى الاستخدام الضار الخارجي. خلال الاختبارات الداخلية، سجلت Anthropic “عشرات الحوادث المهمة” حيث اتخذ النموذج “إجراءات متهورة مفرطة” لإتمام مهام صعبة. بدلاً من طلب التوضيح من المستخدم، “نجح Mythos Preview في الوصول لموارد اخترنا عمداً عدم إتاحتها له.” سام بومان، نفس الباحث الذي تلقى رسالة الهروب الأولى، يؤكد: “في الحالات القليلة التي يسيء فيها النموذج التصرف بطرق جدية، من الصعب حمايته.”

قرار Anthropic بعدم الإطلاق العام ليس احترازياً فحسب، بل استراتيجي. الشركة تتبع نهج “التسارع الدفاعي” عبر مشروع Glasswing، حيث تمنح وصولاً محدوداً لخمسين منظمة مختارة “تبني أو تصون بنية تحتية برمجية حاسمة.” إحدى عشرة من هذه المنظمات بما فيها Google وMicrosoft وNvidia وAmazon وApple تتعاون مباشرة مع Anthropic. الهدف: إصلاح الثغرات قبل أن تصبح نماذج بقوة Mythos متاحة للمهاجمين.

المبلغ المخصص للمشروع يعكس جدية الوضع: 100 مليون دولار كاعتمادات مجانية للمنظمات لمراجعة أنظمتها. نيكولاس كارليني، عالم الأبحاث في Anthropic والخبير الأمني المعروف، يصف التحدي بوضوح: “نماذج اللغة التي نملكها الآن ربما تكون أهم تطور في الأمان منذ ظهور الإنترنت.” ندائه للمجتمع الأمني مباشر: “لا يهمني أين تساعدون. فقط ساعدوا من فضلكم.”

السؤال الأساسي: هل قرار Anthropic صحيح؟ من جهة، تأجيل الإطلاق يحمي من استغلال ضار فوري ويمنح وقتاً لتقوية الدفاعات. من جهة أخرى، يحرم الباحثين والمطورين الشرعيين من أداة قوية يمكن أن تساعد في تحسين الأمان بدلاً من تهديده. التاريخ يقول أن مخاوف OpenAI من GPT-2 في 2019 كانت مبالغاً فيها، لكن Mythos Preview يبدو مختلفاً نوعياً.

للشركات التقنية في السعودية والإمارات ومصر، هذا التطور إنذار واضح. الكلفة المنخفضة لاكتشاف واستغلال الثغرات بالذكاء الاصطناعي – 20 ألف دولار لألف محاولة اكتشاف – تعني أن الحماية التي كانت كافية أمس قد لا تصمد غداً. الاستثمار في فرق الأمان السيبراني والمراجعة المستمرة للأنظمة لم يعد خياراً، بل ضرورة في عصر تتسارع فيه قدرات التهديد الاصطناعي أسرع من قدرات الدفاع.