ليس كل ما يلمع ذهباً، وليس كل خوارزمية معصومة من الخطأ. قضت جدة أميركية خمسة أشهر كاملة خلف القضبان بسبب خطأ في تقنية التعرف على الوجه التي استخدمتها أجهزة إنفاذ القانون، في حادثة تكشف الوجه المظلم لاعتماد الذكاء الاصطناعي في أنظمة العدالة.

تقنيات التعرف على الوجوه ليست مجرد أدوات تحقيق — إنها محاكم رقمية صامتة تصدر أحكاماً قد تدمر حياة بريئة. والمشكلة أن هذه الأنظمة تحمل معدلات خطأ أعلى بشكل ملحوظ مع النساء وكبار السن والأقليات العرقية، مما يجعل العدالة رهناً بخوارزمية منحازة.

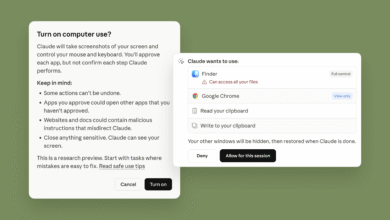

الأخطر من الخطأ التقني هو الثقة المطلقة التي يضعها ضباط الشرطة والمحققون في هذه الأنظمة، دون إجراء تحقيقات إضافية كافية. فحين تقول الخوارزمية “هذا هو المشتبه به”، تتوقف الأسئلة وتبدأ الإجراءات القانونية — وهنا تكمن الكارثة.

في المنطقة العربية، حيث تتسارع الحكومات لتطبيق حلول الذكاء الاصطناعي في الأمن والمراقبة، هذه الحادثة تدق ناقوس خطر حقيقي. هل نحن مستعدون لضمان العدالة حين تخطئ الآلة؟ وما هي الضمانات المطلوبة قبل اعتماد هذه التقنيات في أنظمتنا القضائية؟

لا يمكن أن نقبل مقايضة العدالة بالسرعة، أو التضحية بالدقة من أجل الكفاءة. الذكاء الاصطناعي أداة قوية، لكنها ليست معصومة — والخطأ في العدالة ليس مجرد رقم في تقرير أداء، بل حياة إنسان تُدمر لأشهر أو سنوات.