طرح مشروع llama.cpp الإصدار b8705 الذي يجلب دعماً أصلياً لنموذج step3-vl-10b متعدد الوسائط، مع توفير 24 إصداراً مُحسّناً يغطي كل منصة تشغيل رئيسية من macOS إلى openEuler.

النقلة التقنية الأبرز في هذا التحديث تكمن في تطبيق fused QKV لتسريع معالجة الاستعلامات والمفاتيح والقيم، إلى جانب إعادة هيكلة tensor_mapping.py لتحسين تعيين البيانات. المطورون أضافوا أيضاً معايير العرض والرؤوس إلى MmprojModel.set_gguf_parameters، وحلّوا مشاكل تنسيق الأسطر التي كانت تسبب فوضى في الكود.

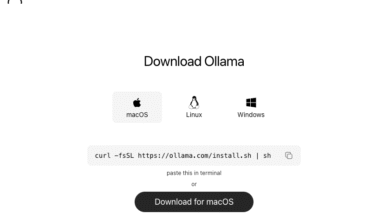

- macOS وiOS: 4 إصدارات تشمل Apple Silicon العادي ومع KleidiAI، Intel x64، و XCFramework للتطبيقات المحمولة

- Ubuntu Linux: 7 إصدارات تدعم x64 وarm64 وs390x مع تسريع Vulkan وROCm 7.2 وOpenVINO 2026.0

- Windows: 8 إصدارات تغطي x64 وarm64 مع CUDA 12.4 و13.1 وVulkan وSYCL وHIP، بملفات DLL منفصلة

- openEuler: 4 إصدارات للبيئات الصينية تدعم معالجات 310p و910b مع ACL Graph للمعالجة المتقدمة

- تحسينات الذاكرة: img_u8_resize_bilinear_to_f32 منقولة داخل فئة step3vl لتحسين إدارة الموارد

للمطورين العرب العاملين في مجال الرؤية الحاسوبية، هذا التحديث يفتح المجال أمام تطوير تطبيقات ذكية تجمع بين فهم النصوص العربية وتحليل الصور في نموذج واحد. الدعم الشامل للمنصات يعني إمكانية النشر عبر البيئات السحابية المختلفة في المنطقة دون قيود تقنية.

التحدي الوحيد يكمن في حجم التحميل الكبير لبعض الإصدارات، خاصة تلك التي تحتوي على مكتبات CUDA الكاملة. قبل التحميل، تأكد من مساحة التخزين المتوفرة ومتطلبات النظام.