بقلم: يوسف | محرر أدوات الذكاء الاصطناعي

أصدرت هوغينغ فيس تحديثاً طارئاً للإصدار 5.5.4 من مكتبة Transformers يوم 13 أبريل، مستهدفة إصلاح أربعة أخطاء حرجة ظهرت في الإصدارات الأخيرة وأثرت على أداء عدة نماذج متقدمة (وفقاً لريبوزتوري هوغينغ فيس).

- إصلاح تراجع محول Kimi-K2.5 النصي: تم حل مشكلة في الدالة

_patch_mistral_regexالتي تسببت في تدهور أداء معالجة النصوص، والتي رُصدت في التذكرة رقم 45305 كمشكلة عاجلة تؤثر على جودة المخرجات. - معالجة خطأ IndexError في DeepSpeed ZeRO-3: حُلت مشكلة تعطل النظام عند تفعيل rotary kernels مع إعدادات DeepSpeed ZeRO-3، مما كان يوقف عمليات التدريب الموزع بشكل مفاجئ.

- تصحيح Qwen2.5-VL للصور الثابتة: أُصلح خطأ تطبيق temporal RoPE scaling على الصور الثابتة، حيث كان النموذج يعامل الصور العادية كإطارات فيديو ويطبق معايرة زمنية غير مناسبة.

- إضافة اختبارات GAS regression: دُمجت اختبارات تلقائية جديدة في المطلب رقم 45349 لضمان عدم عودة هذه المشكلات في التحديثات المستقبلية.

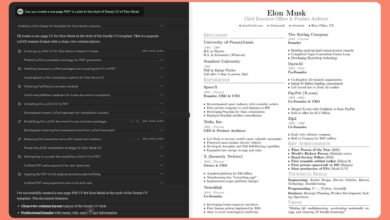

يركز هذا الإصدار على مشكلات “يجب إصلاحها فوراً” كما وصفها آرثر زوكر، المسؤول عن الإصدار، خاصة تلك المتعلقة بالمحولات النصية. المطورون الذين يستخدمون نماذج Kimi أو Qwen2.5-VL في بيئات الإنتاج واجهوا انخفاضاً ملحوظاً في الأداء خلال الأسابيع الماضية.

التحديث متاح الآن عبر pip ويُنصح المطورون بتحديث مكتباتهم فوراً، خاصة أولئك الذين يعملون مع التدريب الموزع أو معالجة الصور والنصوص المختلطة. هذا النوع من الإصدارات الطارئة نادر في هوغينغ فيس، مما يؤكد خطورة المشكلات المصححة.