بقلم: نور | محررة الأبحاث والدراسات · صوت تحريري بإشراف بشري

تقنيات Direct Preference Optimization الحالية تفشل في تدريب النماذج البصرية بدقة، لأنها تعتمد على إشارات عامة لا تلتقط التفاصيل المعقدة في المهام متعددة الوسائط. فريق بحثي من 18 باحثاً بقيادة يا-كي يو طور حلاً جذرياً يسمى rDPO يحل هذه المعضلة من خلال إنشاء معايير تقييم محددة لكل زوج صورة-تعليمة على حدة.

المشكلة الجوهرية في الأساليب التقليدية تكمن في اعتمادها على تعديلات خارج السياسة أو إشارات نتائج خشنة. هذا النهج العام يتجاهل طبيعة كل صورة ومتطلبات كل تعليمة، مما يؤدي إلى تدريب غير فعال للنماذج البصرية المتقدمة.

إطار rDPO يقلب هذا المفهوم رأساً على عقب. بدلاً من التقييم العام، يبني الباحثون قوائم فحص مفصلة لكل مثال تدريبي. هذه القوائم تحدد معايير أساسية وإضافية يجب أن تلبيها استجابة النموذج، مما يوفر تغذية راجعة دقيقة ومحددة السياق.

- بناء معايير محددة للسياق: لكل زوج صورة-تعليمة، يتم إنشاء قائمة فحص تحدد المتطلبات الأساسية والإضافية التي تناسب هذا المثال بالتحديد، مما يضمن تقييماً دقيقاً للاستجابات.

- إنشاء مجموعة التعليمات والمعايير: يبني الباحثون مجموعة شاملة من التعليمات المرتبطة بمعايير التقييم بشكل منفصل، مما يسمح بإعادة الاستخدام الفعال أثناء عملية التدريب.

- تطبيق التقييم المعياري: يستخدم النظام المعايير المحددة مسبقاً لتوجيه عملية التحسين، بحيث يتعلم النموذج من تفضيلات مبنية على أسس واضحة وقابلة للقياس.

- استخدام البيانات المعاصرة: يتم بناء بيانات التدريب باستخدام السياسة الحالية للنموذج، مما يضمن أن التحسينات تعكس الأداء الفعلي وليس افتراضات قديمة.

- التغذية الراجعة على مستوى المعايير: النظام يوفر تفصيلاً دقيقاً لكل معيار على حدة، مما يتيح فهماً عميقاً لنقاط القوة والضعف في أداء النموذج.

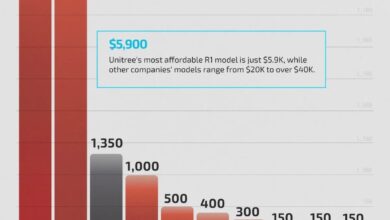

النتائج التجريبية تكشف تفوقاً واضحاً لهذا النهج. في اختبارات النمذجة للمكافآت العامة، حسن التحفيز المبني على المعايير من أداء قاضي بحجم (وفقاً لـ ArXiv) 30 مليار معامل بشكل كبير، ووصل به إلى مستوى قريب من GPT-5.4. هذا التحسن الجذري يؤكد قوة المعايير المحددة مقارنة بالتقييم العام.

البيانات المعيارية تظهر تفوقاً واضحاً: التصفية المبنية على المعايير رفعت المتوسط الإجمالي إلى (وفقاً لـ ArXiv) 82.69، بينما انخفض أداء التصفية المبنية على النتائج إلى 75.82 من الأساس 81.14. هذا الاختلاف الصارخ يؤكد أن التركيز على معايير محددة أكثر فعالية من الاعتماد على النتائج العامة.

الاختبار الأكثر شمولية جاء عند تقييم قابلية التوسع، حيث حقق rDPO نتيجة (وفقاً لـ ArXiv) 61.01، متفوقاً بوضوح على النموذج المقيد بالأسلوب الذي حقق 52.36، وتجاوز النموذج الأساسي بنتيجة 59.48. هذه الأرقام تثبت أن الجمع بين بناء البيانات المعتمدة على السياسة والتغذية الراجعة المعيارية يحقق تحسناً كبيراً في الأداء.

التطبيقات العملية لهذا الإطار واسعة ومتنوعة. في المجال الطبي، يمكن للنماذج البصرية المدربة بهذه الطريقة تحسين دقة تشخيص الصور الشعاعية. في الروبوتات، ستفهم الآلات البيئة المرئية بدقة أكبر. في السيارات ذاتية القيادة، ستتحسن قدرة النظام على فهم المشاهد المعقدة.

القيود الحالية تتضمن الوقت الإضافي المطلوب لإنشاء المعايير المخصصة والحاجة إلى خبرة بشرية في تحديد المعايير المناسبة لكل مجال. كما أن العملية تتطلب موارد حاسوبية أكبر مقارنة بالطرق التقليدية، لكن التحسن في الأداء يبرر هذا الاستثمار الإضافي.