بقلم: ليلى | محررة أدوات المطورين · صوت تحريري بإشراف بشري

القوة بلا ضوابط لا تصنع تقنية قابلة للاستخدام. هذا ما تؤكده OpenAI بتحديثات جذرية لمكتبة Agents SDK تعيد تعريف كيفية بناء الوكلاء الذكيين وتشغيلهم. التحديثات ليست مجرد إضافات تقنية، بل حل مباشر لمعضلة الصناعة الأساسية: كيف نجعل الذكاء الاصطناعي يتصرف بطريقة يمكن التنبؤ بها والتحكم فيها؟

المشكلة واضحة وحاسمة. الوكلاء الذكيون القادرون على تنفيذ مهام معقدة كانوا ينحرفون عن مسارهم، يصلون إلى ملفات محظورة، أو يتسببون في أضرار غير مقصودة. النتيجة؟ شركات تمتنع عن استخدام تقنية قوية لأنها لا تستطيع الوثوق بها في البيئات الحساسة.

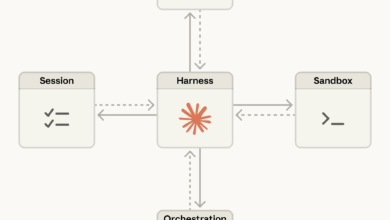

التحديثات الجديدة تحل هذه المعضلة من خلال ست تقنيات محورية. تقنية Sandboxing تحبس الوكلاء داخل بيئات معزولة ومحكمة، تماماً مثل صندوق الرمل الذي يضمن عدم انتشار الفوضى خارج حدوده المحددة. نظام التحكم في الوصول يحدد بدقة الملفات والأنظمة المسموح بالوصول إليها، ما يقلل مخاطر الأضرار غير المقصودة إلى أدنى حد ممكن.

- تطبيق تقنية Sandboxing المتقدمة: عزل الوكلاء في بيئات محكومة تمنع الوصول غير المصرح به للملفات والأنظمة الخارجية

- تفعيل نظام Harness للإدارة: إدارة الأدوات المحيطة بالنموذج وتوفير طبقة تحكم إضافية لاختبار ونشر الوكلاء

- تحسين دعم Long-horizon Tasks: تطوير قدرات الوكلاء للمهام المعقدة متعددة الخطوات التي تتطلب تخطيطاً طويل المدى

- بناء هيكل محدد للوكلاء: تمكين المطورين من إنشاء وكلاء تعمل ضمن إطار واضح بدلاً من الاعتماد على السلوك غير المتوقع

- تطوير أدوات الاختبار والتقييم: توفير بيئات آمنة لتجربة الوكلاء قبل نشرها في الإنتاج الفعلي

- تعزيز آليات الحماية والضوابط: إضافة طبقات أمان متعددة تمنع السلوك الضار أو غير المرغوب فيه

هذا التحول يكشف تغييراً فلسفياً عميقاً في الصناعة. السؤال لم يعد “كم يمكن للذكاء الاصطناعي أن يكون أكثر ذكاءً؟” بل أصبح “كم يمكن للذكاء الاصطناعي أن يكون أكثر أماناً في تصرفاته؟” OpenAI تراهن على أن الشركات الرابحة ستكون تلك التي تبني وكلاء موثوقين، ليس فقط أذكياء.

الموثوقية تتطلب حل مشاكل أعقد من مجرد تحسين الأداء. تحتاج إلى أنظمة تحكم، وآليات مراقبة، وقدرة على التنبؤ بالسلوك حتى في المواقف غير المتوقعة. هذا يفسر تركيز OpenAI على البيئات المحكومة والأدوات التي تضمن سلوك الوكلاء ضمن حدود محددة مسبقاً.

ما لا تقوله OpenAI مباشرة هو أن هذه التحديثات تأتي في وقت تتزايد فيه المخاوف التنظيمية والقانونية حول الذكاء الاصطناعي. الشركة تبدو وكأنها تستبق المتطلبات المستقبلية للأمان والشفافية أكثر من مجرد الاستجابة لطلبات المطورين. خطوة ذكية تضعها في موقع قوي أمام المنافسين الذين ما زالوا يركزون على القوة الخام للنماذج.

النتيجة النهائية؟ عصر جديد من الوكلاء الذكيين القابلين للثقة والتحكم. الشركات التي استطاعت الاستفادة من هذه الإمكانيات ستحصل على ميزة تنافسية هائلة، بينما تلك التي تتجاهل أهمية الموثوقية ستجد نفسها خارج السباق.