بقلم: نور | محررة الأبحاث والدراسات · صوت تحريري بإشراف بشري

خوارزمية التعلم المستمر الفائزة في تجربة واحدة تصبح الأسوأ في أخرى. هذا ما كشفته دراسة جديدة تظهر أن نتائج مقارنات التعلم المستمر تتغير جذرياً بمجرد تعديل استراتيجية الضبط الدقيق.

نشر باحثان أوروبيان Paul-Tiberiu Iordache و Elena Burceanu دراستهما على منصة ArXiv تحت عنوان “Fine-Tuning Regimes Define Distinct Continual Learning Problems”، واختبرا فرضية بسيطة لكن مدمرة: هل تبقى مقارنات خوارزميات التعلم المستمر صحيحة عند تغيير طريقة الضبط الدقيق؟

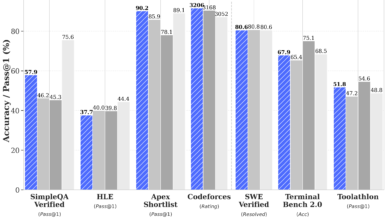

التعلم المستمر يحدد قدرة النموذج على اكتساب مهام جديدة مع الاحتفاظ بالمعرفة السابقة. المشكلة أن معظم الدراسات تثبت استراتيجية الضبط الدقيق، مما يجعل المقارنات مقيدة بسياق تجريبي واحد. الباحثان قررا اختبار أربع خوارزميات شائعة (online EWC، LwF، SI، GEM) عبر خمس استراتيجيات ضبط مختلفة العمق، باستخدام خمس قواعد بيانات معيارية وإجراء 11 ترتيباً مختلفاً للمهام لكل قاعدة (وفقاً لدراسة ArXiv).

- انهيار ثبات التصنيفات: لا توجد خوارزمية واحدة تحافظ على ترتيبها النسبي عبر جميع استراتيجيات الضبط. الخوارزمية المتفوقة في الضبط الضحل قد تصبح الأسوأ في الضبط العميق، مما يعني أن الاستنتاجات حول “أفضل خوارزمية” مضللة.

- تفسير نظري للظاهرة: الباحثان طوروا إطاراً رياضياً يصف استراتيجيات الضبط كتحسين مُسقط عبر مساحات فرعية ثابتة من المعاملات. تغيير العمق القابل للتدريب يؤثر على إشارة التحديث الفعالة المسؤولة عن تعلم المهمة الحالية والحفاظ على المعرفة السابقة.

- علاقة خطيرة بين العمق والنسيان: استراتيجيات الضبط الأعمق تنتج تحديثات أقوى، مستويات نسيان أعلى، وعلاقة أقوى بين قوة التحديث ومعدل النسيان. هذا يفسر لماذا تختلف الخوارزميات في أدائها النسبي عبر الاستراتيجيات.

- شمولية النتائج عبر المجالات: الظاهرة تتكرر عبر قواعد بيانات متنوعة من MNIST البسيطة إلى CIFAR-100 المعقدة، مما يشير إلى أن المشكلة أساسية وليست مقتصرة على مجال واحد.

- تداعيات على الممارسة الصناعية: النتائج تشكك في موثوقية اختيار خوارزميات التعلم المستمر بناءً على دراسات أكاديمية تستخدم استراتيجية ضبط مختلفة عن البيئة المستهدفة في الإنتاج.

المشكلة أعمق مما تبدو. إذا كنت مطور ذكاء اصطناعي في شركة تطبق التعلم المستمر، فالدراسة تقول إن اختيارك للخوارزمية بناءً على بحث أكاديمي قد يكون خاطئاً تماماً. السبب؟ استراتيجية الضبط في بحثهم مختلفة عن استراتيجيتك.

الحل المقترح راديكالي: بروتوكولات تقييم جديدة تعامل عمق التدريب كعامل تجريبي صريح. بدلاً من البحث عن “أفضل خوارزمية” عالمياً، نحتاج مقارنات محددة السياق تأخذ استراتيجية الضبط في الاعتبار. هذا يعني مضاعفة التجارب، لكنه يضمن نتائج قابلة للتطبيق فعلياً.

القيود الحالية واضحة: الدراسة تركز على التعلم التدريجي للمهام (task incremental learning) وتستخدم معماريات شبكات بسيطة نسبياً. التحدي التالي هو اختبار النتائج على نماذج اللغة الكبيرة والمعماريات المعقدة مثل Transformers، حيث استراتيجيات الضبط أكثر تنوعاً.

البحث يمهد لمرحلة جديدة من تطوير خوارزميات التعلم المستمر، حيث التفاعل بين الخوارزمية واستراتيجية الضبط يصبح محور التركيز. النتيجة المرجوة: أنظمة ذكاء اصطناعي تتكيف بفعالية مع البيئات المتغيرة، لكن بمقارنات أكثر دقة وأقل تضليلاً.