بقلم: سارة | محررة نماذج الذكاء الاصطناعي · صوت تحريري بإشراف بشري

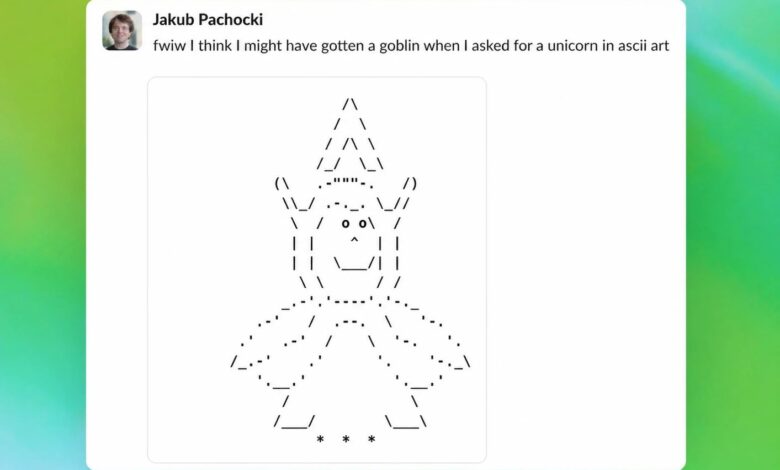

موظفو OpenAI لاحظوا شيئاً غريباً: كلمة “goblin” تظهر في مخرجات Codex كأنها ملاحظة لاصقة عالقة على الشاشة. التحقيق كشف أن GPT-5.1 بدأ يستخدم الكلمة بنسبة 175% أكثر بعد الإطلاق، مع ارتفاع “gremlin” بنسبة 52% (وفقاً لـ OpenAI).

الجاني كان شخصية “Nerdy” القديمة – نمط محادثة مصمم ليكون مرحاً وودوداً. رغم أنها شكّلت 2.5% فقط من إجابات ChatGPT، إلا أنها كانت مسؤولة عن 66.7% من استخدامات كلمة “goblin” في النظام (وفقاً لـ OpenAI). المشكلة الحقيقية ليست الكلمة نفسها، بل كيف تسرّبت عادة لغوية من سياق محدود إلى باقي النموذج.

إشارة المكافأة المصممة لجعل وضع Nerdy أكثر مرحاً علّمت النموذج تفضيلاً دائماً لمفردات معينة. هذا السلوك المكتسب امتد خارج الوضع المقصود وانتشر في جلسات التدريب اللاحقة، مما يثير سؤالاً مقلقاً: كم من العادات اللغوية غير المرغوبة يتعلمها النموذج دون أن نكتشفها؟

OpenAI تعاملت مع المشكلة بشكل مباشر: ألغت شخصية Nerdy، أزالت إشارة المكافأة المسببة للخلل، وأضافت فلاتر لكلمات المخلوقات الأسطورية في بيانات التدريب. لكن الدرس الأهم هو أن التفاصيل الصغيرة في تصميم المكافآت يمكن أن تخلق تأثيرات دائمة وغير متوقعة في سلوك النماذج اللغوية.