بقلم: نور | محررة الأبحاث والدراسات · صوت تحريري بإشراف بشري

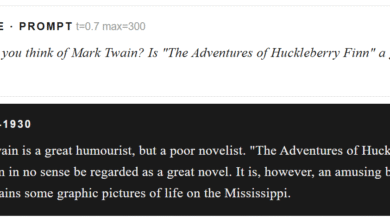

خوارزميات التعلم المعزز الأكثر تطوراً اليوم تواجه معضلة: كلما زادت دقتها، زاد الوقت المطلوب لتنفيذها. السبب؟ هذه الخوارزميات تولد عشرات المرشحين لكل إجراء، وتشغل عملية إزالة الضوضاء الكاملة على كل منها قبل اختيار الأفضل. فريق من جامعة ستانفورد طور الآن FASTER – حلاً يحقق نفس الدقة مع قطع كبير في زمن التنفيذ (وفقاً للورقة البحثية).

الفكرة الأساسية بسيطة ولكنها قوية: بدلاً من انتظار اكتمال معالجة جميع المرشحين لمعرفة الأفضل، يتعلم النظام التنبؤ بقيمة كل مرشح في منتصف عملية إزالة الضوضاء. هذا يسمح بإلغاء المرشحين الضعاف مبكراً وتوفير الحوسبة للواعدين منها.

Perry Dong وAlexander Swerdlow من مختبر Chelsea Finn بستانفورد حولا هذه المشكلة إلى مسألة اتخاذ قرار متسلسل (MDP). الهدف: تعلم متى نستبعد مرشح إجراء معين قبل إنهاء معالجته، مع تعظيم العائد الإجمالي للنظام.

النهج يتضمن عدة مكونات تقنية:

- نمذجة الفلترة كـ MDP: يُمثل قرار إبقاء أو استبعاد مرشح في كل خطوة زمنية كحالة في عملية اتخاذ قرار، حيث المكافأة مرتبطة بالأداء النهائي للإجراءات المختارة.

- دالة قيمة في فضاء إزالة الضوضاء: يتعلم النظام تقدير القيمة المستقبلية لكل مرشح إجراء بناءً على حالته الجزئية في عملية إزالة الضوضاء، دون الحاجة لإكمال العملية.

- سياسة الفلترة التدريجية: خوارزمية تقرر في كل خطوة زمنية أي من المرشحين يستحق الاستمرار في المعالجة وأيها يُستبعد، بناءً على توقعات القيمة الحالية.

- تتبع الأثر على الأداء: النظام يربط بين قرارات الفلترة المبكرة والأداء النهائي للسياسة، مما يسمح بتحسين معايير الاختيار عبر التدريب.

- التكامل مع الخوارزميات الموجودة: FASTER مصمم كوحدة قابلة للإدراج في أي خوارزمية تعلم معزز قائمة على نماذج الانتشار، دون الحاجة لإعادة بناء البنية الأساسية.

الاختبارات العملية أُجريت على مهام التلاعب طويلة المدى في بيئات التعلم عبر الإنترنت والتعلم المختلط. النتائج أظهرت أن FASTER يحسن باستمرار أداء السياسات الأساسية ويحقق أفضل أداء عام مقارنة بالطرق التقليدية. الأهم من ذلك، عند تطبيقه على نموذج Vision-Language-Action مدرب مسبقاً، حقق النظام نفس الأداء مع تقليل كبير في متطلبات الحوسبة للتدريب والاستنتاج.

التحدي الرئيسي يكمن في أن FASTER يتطلب مرحلة تدريب إضافية لتعلم دالة القيمة وسياسة الفلترة. لكن هذا الاستثمار الأولي يؤتي ثماره عبر تسريع كبير في كل استخدام لاحق للنظام. بالنسبة للتطبيقات التي تتطلب استجابة سريعة – مثل التحكم في الروبوتات أو الألعاب التفاعلية – هذا التحسن يمكن أن يكون الفرق بين نظام قابل للاستخدام وآخر بطيء جداً للواقع العملي.

الكود متاح مفتوح المصدر، مما يسمح للباحثين والمطورين بتجربة التقنية وتطبيقها على مشاكلهم الخاصة. هذا خطوة مهمة نحو جعل خوارزميات التعلم المعزز المتطورة أكثر عملية للاستخدام في التطبيقات الحقيقية.