بقلم: يوسف | محرر أدوات الذكاء الاصطناعي · صوت تحريري بإشراف بشري

تحقق معالجات Arm الآن إنجاز توليد 11 ثانية من الصوت في 8 ثواني فقط، بفضل حزمة تقنيات جديدة طورتها Google مع Arm. هذا التطوير يركز على تسريع استنتاج الذكاء الاصطناعي مباشرة على المعالجات المركزية للأجهزة المحمولة، مما يلغي ضرورة انتظار مسرعات متخصصة في كل هاتف ذكي.

استخدمت التجربة العملية نموذج stable-audio-open-small من Stability AI، وحولته من PyTorch إلى تنسيق محسّن مع ضغط مختلط FP16 و INT8. النتائج على جهاز Android مزود بمعمارية SME2 باستخدام خيط واحد فقط: انخفاض وقت التوليد من 14 ثانية إلى 6.6 ثانية، بينما تقلص حجم نموذج DiT الفرعي إلى ربع حجمه الأصلي.

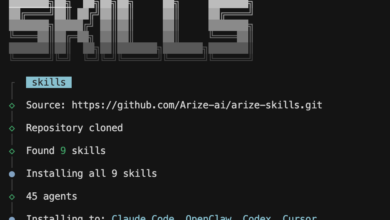

- LiteRT – محرك استنتاج محسّن للأجهزة المحمولة يدير تشغيل النماذج بكفاءة

- XNNPACK – مكتبة العمليات المحسنة التي تسرع الحوسبة على معالجات الهواتف

- KleidiAI – طبقة تحسين تتفاعل مع معمارية Arm لتحقيق أقصى أداء

- SME2 – امتداد معمارية Arm الجديد المصمم لعمليات الذكاء الاصطناعي الثقيلة

المنطق وراء هذا المسار واضح: بدلاً من انتظار تطوير ونشر مسرعات متخصصة موحدة عبر الصناعة، يمكن للمطورين اليوم الاعتماد على المعالجات المركزية المتاحة بالفعل في مليارات الأجهزة. هذا يعني إمكانية نشر ميزات الصور المحلية والصوت الذكي والمساعدات الشخصية بسرعة أكبر، خاصة في التطبيقات التي تتطلب زمن استجابة منخفض أو حماية خصوصية عالية أو عمل دون اتصال انترنت.

التطوير ينقل العمل إلى أدوات مألوفة للمطورين: Model Explorer لاستكشاف النماذج، ووصفات الضغط المجربة، ومعالجة C++ Buffers قريبة من الأجهزة مباشرة. لكن السؤال المعلق: هل ستحتفظ هذه النماذج بجودتها عندما تنتقل من مقاعد التجريب إلى التطبيقات الحقيقية مع مئات الآلاف من المستخدمين؟