يتسارع تطور الذكاء الاصطناعي بوتيرة غير مسبوقة، فيما تتنافس عدة أطراف رئيسية على تشكيل مستقبله التنظيمي والأخلاقي. وفي الولايات المتحدة، يبرز انقسام حاد بين صناع القرار، وشركات التقنية، وصناعة الترفيه، حول من يملك حق وضع القواعد.

في واشنطن، لا يزال الكونغرس بطيئًا في سن تشريعات شاملة، ما دفع عددًا من الولايات إلى صياغة قوانين محلية لتنظيم الذكاء الاصطناعي. غير أن الرئيس دونالد ترامب وقّع الأسبوع الماضي أمرًا تنفيذيًا يهدف إلى منع الولايات من سن تشريعات مستقلة، والسعي بدلًا من ذلك إلى إطار وطني موحّد. وقد قوبلت الخطوة بمعارضة من الحزبين، وسط جدل قانوني وسياسي متصاعد.

في المقابل، تسعى شركات التقنية إلى لعب دور مباشر في صياغة القوانين. فقد نشرت شركة رأس المال الجريء Andreessen Horowitz خارطة طريق تشريعية من تسعة محاور، تدعو الكونغرس لاعتمادها كأساس لتنظيم الذكاء الاصطناعي، مع التركيز على بناء منتجات موثوقة تحمي الأفراد وتدعم استدامة الأعمال على المدى الطويل.

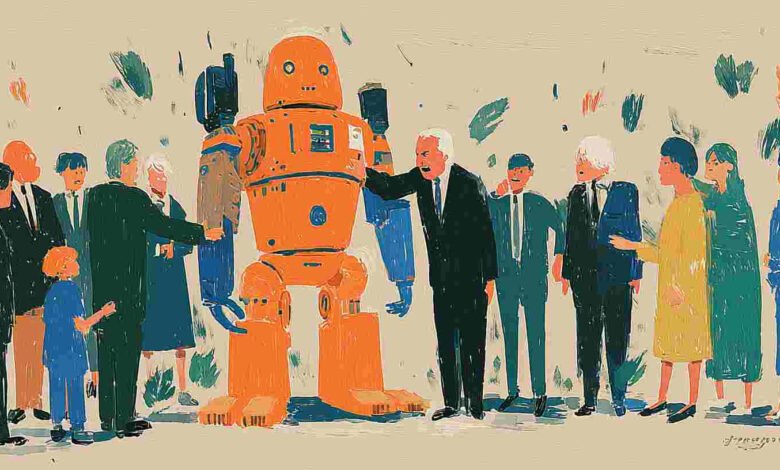

أما في هوليوود، فقد أعلنت مجموعة جديدة تُدعى Creators Coalition on AI عن انطلاقها هذا الأسبوع، مع أكثر من 500 موقّع من صناع المحتوى والممثلين والكتّاب، من بينهم بن أفليك وناتالي بورتمان وآرون سوركين. وتؤكد المجموعة أنها ترسم «خطًا فاصلًا بين من يريد التطوير بسرعة، ومن يريد القيام به بالشكل الصحيح». وجاء تأسيس الائتلاف جزئيًا ردًا على استثمار ديزني البالغ مليار دولار في أوبن إيه آي، وهو اتفاق فاجأ العديد من العاملين في القطاع الإبداعي.

ويرى مراقبون أن العامين المقبلين سيكونان حاسمين، إذ إن القواعد التي ستُكتب الآن لن تنظم تطبيقات الذكاء الاصطناعي الحالية فحسب، بل ستُرسي الأساس للجيل القادم من التقنيات**—وسط سباق محموم بين الحكومات، والشركات، وصنّاع الثقافة لتحديد من يضع الخطوط العريضة للمستقبل.

📌 الملخص:

واشنطن، شركات التقنية، وهوليوود تدخل سباقًا لتحديد قواعد الذكاء الاصطناعي، في لحظة قد تحدد شكل التنظيم والابتكار لعقد كامل قادم.