أوبن أي آي تطلق برنامج مكافآت لاكتشاف مخاطر الذكاء الاصطناعي

أطلقت أوبن أي آي برنامج مكافآت عام يتجاوز نطاق الثغرات الأمنية التقليدية ليشمل اكتشاف سيناريوهات إساءة استخدام الذكاء الاصطناعي. هذه خطوة غير مسبوقة في الصناعة — فبدلاً من مكافأة الباحثين على العثور على ثغرات في الكود فقط، ستدفع الشركة لمن يكشف طرق استغلال نماذجها لأغراض ضارة.

ما الذي تغيّر؟

البرنامج يستهدف نوعين من المخاطر: المخاطر التقليدية مثل تسرب البيانات والوصول غير المصرح به، ومخاطر جديدة تماماً تتعلق بسوء السلوك في النماذج نفسها. الشركة تبحث عن حالات يمكن فيها خداع GPT أو DALL-E لإنتاج محتوى ضار، أو استغلالهما لأتمتة أنشطة احتيالية، أو حتى التلاعب بهما لتقديم معلومات مضللة بطريقة مقنعة.

يشمل البرنامج أيضاً فرق اختبار الاختراق الأخلاقي التي تحاكي سيناريوهات حقيقية لإساءة الاستخدام. هؤلاء الباحثون سيحصلون على وصول مبكر لنماذج تحت التطوير لاختبار حدودها قبل الإطلاق العام.

لماذا يهمك؟

إذا كنت تطور تطبيقاً يعتمد على API أوبن أي آي في السعودية أو الإمارات، فهذا البرنامج يعني بيئة أكثر أماناً لمنتجك. المخاطر التي ستكتشفها الفرق المتخصصة ستقلل من احتمالية تعرض تطبيقك لسوء الاستخدام من المستخدمين النهائيين.

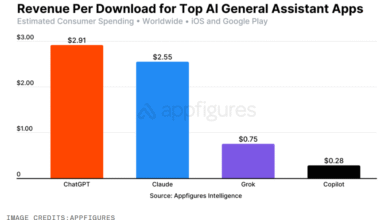

البرنامج يفتح أيضاً فرصة دخل جديدة للمطورين العرب المتخصصين في الأمن السيبراني. المكافآت تبدأ من مئات الدولارات وتصل لآلاف حسب خطورة المشكلة المكتشفة.

ما الذي لا يُقال؟

البرنامج لا يشمل كل منتجات أوبن أي آي — فعلى سبيل المثال، لم تذكر الشركة ما إذا كان يغطي ChatGPT Enterprise أو الإصدارات المخصصة للشركات. كما أن عملية التقييم والموافقة على المكافآت قد تستغرق وقتاً طويلاً، خاصة للمخاطر الجديدة التي لا توجد معايير واضحة لتقييمها.

هذا ليس مجرد برنامج مكافآت عادي — إنه اعتراف ضمني بأن مخاطر الذكاء الاصطناعي تتجاوز ما يمكن لفرق الأمان الداخلية اكتشافه وحدها.