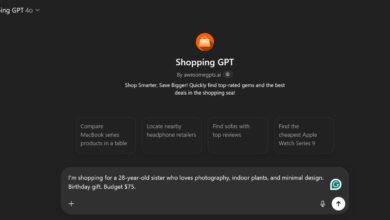

168 ألف مطور يتابعون مشروع Ollama على GitHub، وآخر إطلاق يحمل الرقم 0.20.5 مع ميزة جوهرية: ربط النماذج المحلية بتطبيقات التراسل المعتادة. ما يعنيه هذا بوضوح أن محادثاتك مع النماذج المدربة محلياً تصبح متاحة الآن عبر واتساب وتيليجرام وديسكورد من أي جهاز.

التطبيق العملي واضح ومباشر. بدلاً من التنقل بين سطر الأوامر وواجهة الويب المحلية، تحصل على وصول فوري للنموذج عبر التطبيقات التي تستخدمها بالفعل. الإعداد يتطلب تشغيل ollama launch openclaw واتباع خطوات الربط لكل تطبيق منفرداً.

النقطة التقنية الأهم في هذا التحديث هي دعم flash attention لنموذج Gemma 4 على وحدات المعالجة المتوافقة. هذا التحسين يقلل استهلاك ذاكرة الوصول العشوائي ويزيد سرعة الاستجابة، خاصة في المحادثات الطويلة أو عند معالجة نصوص معقدة. كما يحل الإصدار مشكلة الأمر /save للنماذج التي تعتمد على معمارية safetensors.

للمطورين العرب الذين يعملون على تطبيقات محادثة أو نظم دعم عملاء، هذا التطوير يختصر مراحل تطوير كاملة. بدلاً من بناء API مخصص أو استخدام خدمات خارجية مكلفة، النموذج المحلي يصبح متاحاً عبر البنية التحتية الموجودة للتراسل الفوري.

التحديث يتضمن مساهمة من المطور sjhddh في طلب السحب 15424، ويدعم كشف تثبيتات OpenCode القائمة على curl في المسار ~/.opencode/bin تلقائياً.

الحد الواضح هنا أن الاتصال يظل معتمداً على استقرار الإنترنت، والاستخدام المكثف قد يؤثر على بطارية الخادم المحلي. لكن للاستخدامات المتوسطة، هذا التكامل يحل مشكلة الوصول الفوري للنماذج المخصصة دون التنازل عن الخصوصية المحلية.