بقلم: يوسف | محرر أدوات الذكاء الاصطناعي · صوت تحريري بإشراف بشري

مهندس سابق في Tesla و Netflix يحول مشكلة تكاليف الذكاء الاصطناعي إلى حل تقني متكامل. Osaurus تطبيق مفتوح المصدر يتيح لمستخدمي Mac التنقل بحرية بين النماذج المحلية والسحابية عبر واجهة واحدة، مع الاحتفاظ بالملفات والأدوات والذاكرة على الجهاز المحلي.

بدأت القصة مع Dinoki، مساعد سطح المكتب الذي وصفه المؤسس المشارك Terence Pae بأنه “Clippy مدعوم بالذكاء الاصطناعي”. المشكلة الحقيقية ظهرت عندما سأل العملاء: “لماذا ندفع مقابل التطبيق إذا كنا لا نزال مضطرين لدفع tokens؟” – وحدات الاستخدام التي تفرضها شركات الذكاء الاصطناعي مقابل معالجة الطلبات وتوليد الردود (وفقاً لـ TechCrunch).

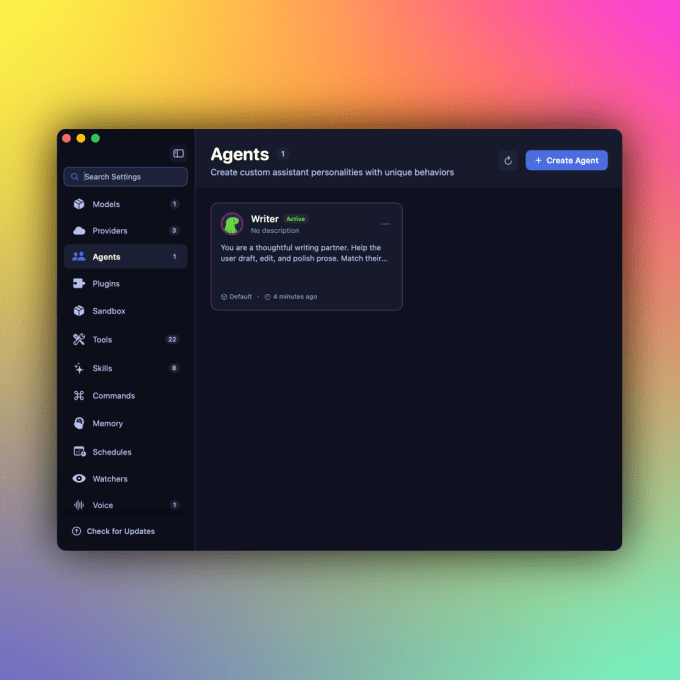

هنا ولدت فكرة Osaurus كحل لتشغيل مساعد ذكي محلياً. “يمكنك فعل أي شيء تقريباً على Mac محلياً، مثل تصفح ملفاتك والوصول إلى متصفحك وإعدادات النظام. اعتقدت أن هذه ستكون طريقة رائعة لوضع Osaurus كذكاء اصطناعي شخصي للأفراد”، يشرح Pae. بناء المشروع في العلن كمفتوح المصدر سمح بإضافة ميزات وإصلاح الأخطاء على طول الطريق.

النتيجة أداة تصنف كـ”harness” – طبقة تحكم تربط نماذج الذكاء الاصطناعي المختلفة والأدوات وسير العمل عبر واجهة واحدة، مشابهة لـOpenClaw أو Hermes. لكن الفارق الجوهري أن هذه الأدوات تستهدف المطورين المتمرسين في Terminal، وقد تحمل ثغرات أمنية. Osaurus يقدم واجهة استهلاكية سهلة مع معالجة المخاوف الأمنية عبر sandbox افتراضي معزول بالأجهزة، مما يحد من الذكاء الاصطناعي لنطاق محدد ويحافظ على أمان الجهاز والبيانات.

تشغيل النماذج المحلية يتطلب موارد كبيرة – 64 GB من ذاكرة الوصول العشوائي كحد أدنى، و128 GB للنماذج الأكبر مثل DeepSeek V4. لكن Pae متفائل بشأن المستقبل: “الذكاء لكل واط – مقياس الذكاء الاصطناعي المحلي – يرتفع بشكل كبير. العام الماضي، بالكاد كان الذكاء الاصطناعي المحلي ينهي الجمل، لكن اليوم يمكنه تشغيل الأدوات وكتابة الكود والوصول إلى متصفحك وطلب الأشياء من Amazon… يتحسن باستمرار”.

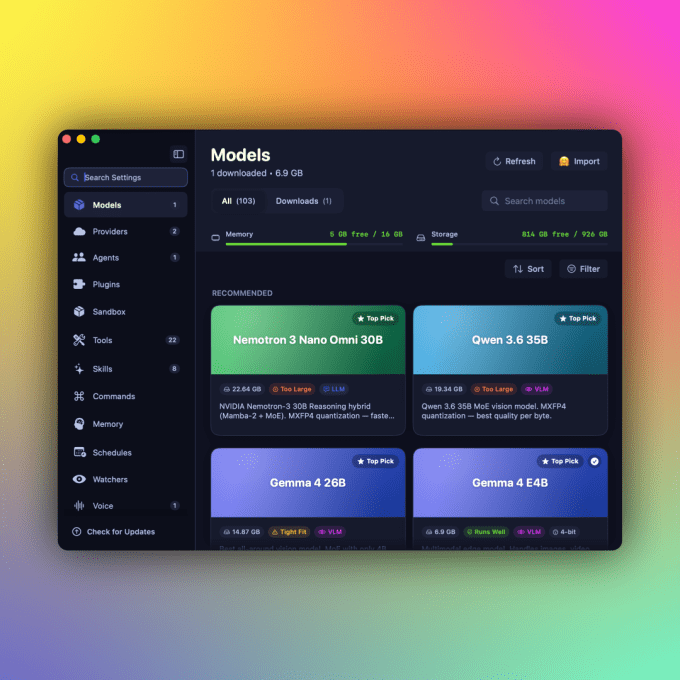

الأداة تدعم مجموعة واسعة: MiniMax M2.5، Gemma 4، Qwen3.6، GPT-OSS، Llama، DeepSeek V4 محلياً، بالإضافة لنماذج Apple الأساسية المدمجة وعائلة LFM من Liquid AI. سحابياً، تتصل بـOpenAI وAnthropic وGemini وxAI/Grok وVenice AI وOpenRouter وOllama وLM Studio. كخادم MCP كامل، تمنح أي عميل متوافق الوصول للأدوات، مع أكثر من 20 plugin أصلي للبريد والتقويم والرؤية واستخدام macOS وXLSX وPPTX والمتصفح والموسيقى وGit ونظام الملفات والبحث.

الإضافات الحديثة تشمل القدرات الصوتية. منذ الإطلاق قبل عام تقريباً، حُمل المشروع أكثر من 112,000 مرة (وفقاً لموقع Osaurus). يتنافس مع Ollama وMsty وLM Studio، لكنه يتميز بواجهة أكثر ودية لغير المطورين ومجموعة ميزات متخصصة.

المؤسسون (Terence Pae وSam Yoo) يشاركون حالياً في مسرعة Alliance في نيويورك، ويفكرون في توسيع Osaurus للشركات، خاصة في القطاعات القانونية والصحية حيث تشغيل LLMs محلياً يعالج مخاوف الخصوصية. رؤيتهم طموحة: مع تطور قوة النماذج المحلية، قد تقل الحاجة لمراكز بيانات الذكاء الاصطناعي.

“نرى نمواً متفجراً حيث موفرو الذكاء الاصطناعي السحابي يتوسعون بمراكز البيانات والبنية التحتية، لكن الناس لم يروا قيمة الذكاء الاصطناعي المحلي بعد”، يوضح Pae. “بدلاً من الاعتماد على السحابة، يمكن نشر Mac Studio محلياً باستهلاك طاقة أقل بكثير. تحتفظ بقدرات السحابة دون الاعتماد على مراكز البيانات”.

التحدي الحقيقي ليس تقنياً فحسب، بل اقتصادي أيضاً. عندما تصبح النماذج المحلية قوية بما يكفي وأقل استهلاكاً للموارد، قد نشهد تحولاً جذرياً في بنية صناعة الذكاء الاصطناعي بأكملها.