بقلم: يوسف | محرر أدوات الذكاء الاصطناعي · صوت تحريري بإشراف بشري

تعيد Ollama تشكيل تجربة البرمجة المحلية بإطلاق الإصدار 0.24.0 الذي يدمج Codex App من OpenAI كتجربة سطح مكتب أصلية للمطورين. هذا ليس مجرد تحديث تقني، بل خطوة لدمج أدوات البرمجة الذكية في بيئة واحدة متماسكة.

- تشغيل Codex App فورياً: عبر الأمر

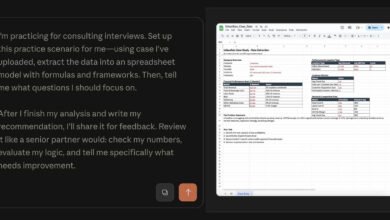

ollama launch codex-appللوصول المباشر لبيئة البرمجة مع دعم worktree المدمج وإمكانيات Git الكاملة - متصفح مدمج للتطوير: يحمّل الخوادم والمواقع المحلية مباشرة داخل التطبيق مع إمكانية التعليق على الصفحات لطلب تعديلات محددة

- وضع المراجعة التفاعلي: فحص الكود وترك التعليقات والتكرار دون مغادرة مساحة العمل أو التنقل بين تطبيقات متعددة

- نماذج متخصصة للمهام المختلفة: kimi-k2.6 مع دعم الرؤية وglm-5.1 للمهام البرمجية المعقدة والوكيلة

- خيارات محلية بدون اشتراك: nemotron-3-super وgemma4:31b وqwen3.6 للاستخدام المحلي الكامل دون الحاجة لـ Ollama Cloud

- استعادة الإعدادات السابقة: الأمر

ollama launch codex-app --restoreيعيد التكوين السابق في حالة الحاجة للتراجع

التحسن الأهم يكمن في إعادة كتابة MLX sampler بالكامل لتحسين جودة الإنتاج على معالجات Apple Silicon (وفقاً لـ GitHub Release). هذا يعني أداءً أسرع وأكثر دقة للمطورين الذين يعتمدون على أجهزة Mac مع شرائح M-series، وهو تطوير حاسم مع تزايد اعتماد هذه المعالجات في مجتمع المطورين.

ما يميز هذا الإصدار هو دعم الرؤية في نموذج kimi-k2.6، مما يفتح إمكانيات جديدة لتحليل واجهات المستخدم ولقطات الشاشة والمخططات مباشرة أثناء البرمجة. هذا التطور يقلل الحاجة لأدوات منفصلة ويسرّع عملية التطوير بشكل ملحوظ.

التحدي الأساسي يبقى في إدارة الموارد – النماذج الأكبر مثل gemma4:31b تتطلب ذاكرة RAM كبيرة، والسؤال هو ما إذا كان التحسين الجديد لـ MLX سيكفي لتشغيل هذه النماذج بكفاءة على الأجهزة المحدودة. لكن الخيارات المتنوعة للنماذج تعطي المطورين مرونة اختيار النموذج المناسب لقدرات أجهزتهم.

هذا التحديث يضع Ollama في منافسة مباشرة مع بيئات التطوير السحابية، لكن مع ميزة الخصوصية والتحكم المحلي الكامل – وهو ما يهم فرق التطوير التي تتعامل مع كود حساس أو تواجه قيود الشبكة.