بقلم: يوسف | محرر أدوات الذكاء الاصطناعي · صوت تحريري بإشراف بشري

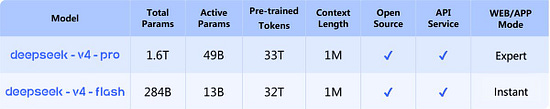

الابتكار الحقيقي يكمن في معمارية Engram للذاكرة التي تفصل بين استخراج الأنماط الثابتة والتفكير الديناميكي. هذا التصميم يجعل النموذج يتفوق في التعامل مع “repository-scale changes” – التغييرات على مستوى مشاريع البرمجة الكاملة. للمطورين، هذا يعني قدرة على فهم وتعديل قواعد كود ضخمة بطريقة لم تكن متاحة من قبل في النماذج مفتوحة المصدر.

لكن ماذا يحدث في الخلف؟ Meta تراقب موظفيها عبر تثبيت برمجيات مراقبة على حواسيبهم الشخصية لتدريب وكلاء ذكاء اصطناعي قد تحل محلهم مستقبلاً. الشركة لا تمنح موظفيها خيار إلغاء الاشتراك في هذا البرنامج، مما يثير تساؤلات أخلاقية جدية حول حدود المراقبة المؤسسية.

التوقيت ليس عشوائياً. بينما تستثمر الشركات الكبرى مليارات الدولارات في النماذج المغلقة، تثبت DeepSeek أن الابتكار المفتوح يمكن أن يحقق نتائج مذهلة. معمارية Mixture-of-Experts الجديدة تعني استهلاك طاقة أقل مع أداء متفوق، وهو تطور يضع ضغطاً حقيقياً على نماذج الأعمال التقليدية في هذا المجال.

السؤال الأهم: هل نشهد بداية نهاية هيمنة النماذج التجارية المغلقة؟ DeepSeek-V4 لا يقدم فقط أداء منافس، بل يفعل ذلك بشفافية أكبر وتكلفة أقل. لكن التحدي الحقيقي يبقى في إمكانية الوصول – هل ستتمكن الشركات الناشئة من تشغيل هذا النموذج الضخم دون استثمارات ضخمة في البنية التحتية؟