بقلم: يوسف | محرر أدوات الذكاء الاصطناعي · صوت تحريري بإشراف بشري

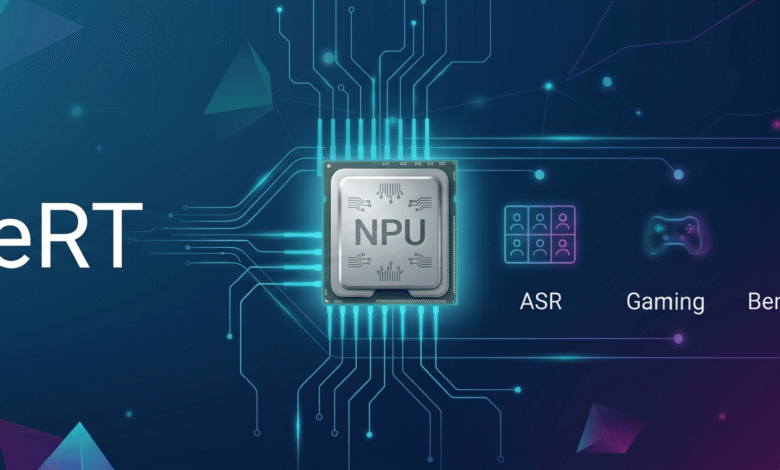

مشكلة الهاتف الذي يسخن أثناء مكالمات الفيديو وجدت حلها في LiteRT من جوجل. هذه المنصة الجديدة تنقل المعالجة من وحدات GPU المستهلكة للطاقة إلى وحدات NPU المخصصة للذكاء الاصطناعي، مما يحل معادلة صعبة: تشغيل نماذج أكثر تعقيداً مع استهلاك طاقة أقل.

الأرقام الحقيقية تُظهر الفرق. Google Meet يشغل الآن نموذج تجزئة أكبر 25 مرة من النموذج السابق، وحققت شركة Epic Games سرعة 30 إطار في الثانية لرسوم MetaHuman الوجهية المتحركة، بينما سجلت Argmax تحسناً يزيد عن الضعف في السرعة بالانتقال من GPU إلى NPU.

- تثبيت SDK الجديد: ابدأ بتحديث مشروعك لاستخدام LiteRT بدلاً من TensorFlow Lite القديم، مع تأكد من دعم الجهاز المستهدف لوحدات NPU

- تحويل النموذج: استخدم أدوات التحويل المدمجة لتحسين نموذجك للتشغيل على وحدات NPU، مع الانتباه لقيود الذاكرة الخاصة بكل معالج

- اختبار الأداء: استخدم بوابة المعايير التي تضم أكثر من 100 هاتف لقياس أداء نموذجك على أجهزة مختلفة قبل النشر

- تحسين استهلاك الطاقة: راقب استهلاك البطارية مقارنة بالتشغيل على GPU، مع ضبط تكرار التنفيذ حسب الحاجة

- معالجة الأخطاء: أضف آليات للتراجع إلى GPU في حالة عدم توفر NPU أو فشل التشغيل

- قياس زمن الاستجابة: اختبر التحسن في زمن الاستجابة مقارنة بالمعالجة السحابية، خاصة في البيئات ضعيفة الاتصال

السؤال الأهم هو تبني المطورين لهذه التقنية. البطارية تبقى القيد الأساسي في تطبيقات الهواتف، ووحدات NPU تعد بحل هذه المشكلة. لكن انتقال فرق التطوير من نهج “رفع كل شيء للسحابة” إلى “معالجة محلية ذكية” يتطلب إعادة تفكير في البنية المعمارية للتطبيقات.

تحدي آخر يكمن في تنوع موردي الرقائق. كل مصنع له مواصفات NPU مختلفة، وLiteRT تحاول توحيد هذا التعقيد خلف واجهة برمجية واحدة. نجاح هذا الهدف سيحدد مدى انتشار المنصة بين المطورين.