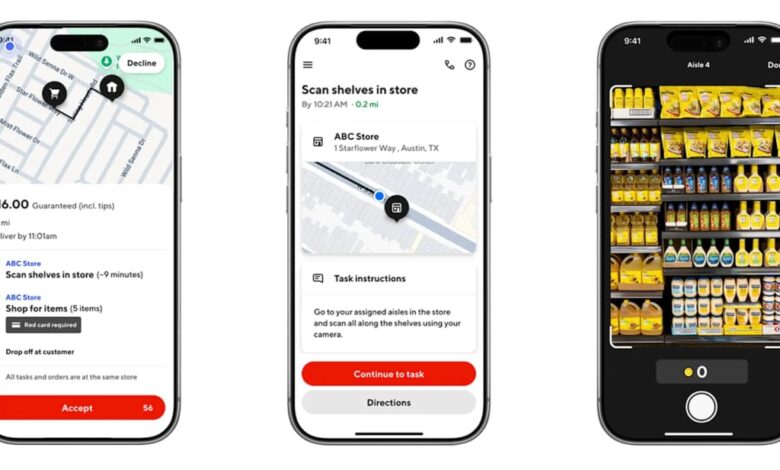

دور داش تطلق تطبيق Tasks لجمع بيانات الذكاء الاصطناعي

أطلقت شركة دور داش تطبيق Tasks الجديد الذي يدفع للعمال مقابل جمع البيانات لأنظمة الذكاء الاصطناعي. يقوم التطبيق بتصوير الأنشطة اليومية مثل غسل الأطباق أو التحدث بلغات أخرى. وبالتالي تحولت ملايين العمال إلى شبكة موزعة لجمع البيانات على نطاق واسع.

ماذا حدث؟

أطلقت شركة دور داش تطبيق Tasks كأداة مبتكرة لجمع البيانات لتدريب أنظمة الذكاء الاصطناعي. يعمل التطبيق على تحويل عمال التوصيل إلى جامعي بيانات مقابل أجر مالي. كما أن النظام يطلب من المستخدمين تسجيل أنشطة حياتية بسيطة مثل غسل الأطباق أو التحدث بلغات مختلفة. وتجدر الإشارة إلى أن الشركة تستخدم هذه البيانات لتدريب أنظمة الذكاء الاصطناعي والروبوتات على فهم العالم الفيزيائي بشكل أفضل. بالإضافة إلى ذلك، يحول هذا النهج ملايين عمال التوصيل إلى شبكة موزعة لجمع البيانات على نطاق عالمي. دور داش لم تكشف تفاصيل الأجور أو آليات العمل الدقيقة.

السياق والمشهد الأشمل

تتجه شركة أوبر في نفس الاتجاه وفقاً للمصدر، مما يشير إلى اتجاه صناعي جديد. في المقابل، تعتمد معظم شركات التكنولوجيا التقليدية على توظيف متخصصين لجمع البيانات. ومع ذلك، يمثل هذا النهج تحولاً جذرياً حيث تقوم الشركات بـ “الاستعانة بمصادر خارجية للواقع نفسه” كما ذكر المصدر. وفضلاً عن ذلك، يعكس هذا التطور الحاجة المتزايدة للبيانات عالية الجودة لتدريب أنظمة الذكاء الاصطناعي المتقدمة. على سبيل المثال، تحتاج أنظمة الروبوتات إلى فهم كيفية تفاعل البشر مع البيئة المحيطة. نتيجةً لذلك، تسعى الشركات لإيجاد طرق مبتكرة لجمع هذه البيانات بتكلفة أقل وكفاءة أكبر.

لماذا يهم؟

يمثل هذا التطور نقلة في كيفية جمع البيانات لتدريب أنظمة الذكاء الاصطناعي والروبوتات. وبالتالي قد يؤثر على ملايين العمال الذين يمكنهم كسب دخل إضافي من خلال هذه المهام. كما أن الشركات ستحصل على بيانات متنوعة من البيئات الحقيقية بدلاً من البيئات المعملية المحدودة. في المقابل، قد يثير هذا النهج تساؤلات حول الخصوصية وحقوق العمال. وتجدر الإشارة إلى أن هذا الاتجاه قد يؤدي إلى تسريع تطوير تقنيات الروبوتات والذكاء الاصطناعي المتقدمة. بالإضافة إلى ذلك، يمكن أن يقلل من التكاليف المرتبطة بجمع البيانات التقليدية للشركات التقنية.

ما التالي؟

لم يذكر المصدر تفاصيل حول خطط التوسع أو الجدول الزمني لتطبيق Tasks. ومع ذلك، من المتوقع أن تحذو شركات أخرى حذو دور داش وأوبر في هذا المجال. كما أن نجاح هذا النموذج قد يؤدي إلى ظهور منصات مشابهة متخصصة في جمع البيانات. وتجدر الإشارة إلى أن هذا التطور يستحق المتابعة ضمن أخبار الذكاء الاصطناعي المتعلقة بالابتكارات الجديدة. بالإضافة إلى ذلك، يمكن للمهتمين تعلم المزيد عن تقنيات تعلم واستخدام الذكاء الاصطناعي لفهم كيفية استخدام هذه البيانات في التدريب.

أبرز النقاط

- إطلاق تطبيق Tasks من دور داش لتحويل عمال التوصيل إلى جامعي بيانات مدفوعي الأجر

- استخدام البيانات المجمعة لتدريب أنظمة الذكاء الاصطناعي والروبوتات على فهم الأنشطة البشرية اليومية

- توجه صناعي جديد نحو الاستعانة بمصادر خارجية لجمع بيانات الواقع بدلاً من الاعتماد على المتخصصين