بقلم: نور | محررة الأبحاث والدراسات · صوت تحريري بإشراف بشري

أثبت فريق SeqPU أن نموذج Gemma 2B من جوجل حقق 8.0 نقطة على معيار MT-Bench متفوقاً على GPT-3.5 Turbo الذي سجل 7.94، والمفاجأة أن النموذج الفائز يعمل بـ2 مليار معامل فقط على معالج CPU عادي بينما منافسه يحتاج 175 مليار معامل على مجموعة GPU سحابية (وفقاً لـ SeqPU).

الاختبار شمل 80 سؤالاً مفتوحاً بدورتين لكل سؤال عبر الكتابة والمنطق والرياضيات والبرمجة والعلوم، مع تطبيق wrapper بايثون بسيط من 169 سطراً دون أي تحسينات أو حيل هندسية. النتيجة تهدم الاعتقاد السائد أن النماذج القوية تتطلب موارد حاسوبية ضخمة وتكلفة شهرية باهظة.

التجربة كشفت أن ما اعتبره المجال “مشكلة قوة حاسوبية” هو في الحقيقة مشكلة هندسة برمجيات يمكن لأي مطور معالجتها في عطلة نهاية أسبوع. الفريق حلل 160 دورة حوار كاملة ووثق كل خطأ مع أسبابه المحددة، ليكتشف أن أخطاء النموذج ليست “هلاوس” غامضة بل سبعة أنماط فشل قابلة للتكرار والإصلاح.

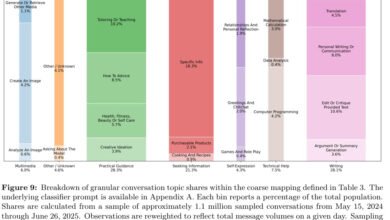

- الكتابة (7.40/10): أنتج مقالات سفر بتفاصيل ثقافية دقيقة وشخصيات أدبية بإشارات لبيوولف ودوستويفسكي وشكسبير، لكنه فشل في القيود الهيكلية مثل “جمل رباعية الكلمات” حيث نجح في 5 من 17 محاولة فقط، و”قصائد أقل من 10 أسطر” التي تجاوزها مرتين لـ20+ سطراً

- تمثيل الأدوار (7.35/10): تفوق في الشخصيات العامة كإيلون ماسك (“وضع البشرية في سلة كوكبية واحدة جنون”) وتوني ستارك (“أنا أبني أشياء تعمل”)، لكن تدريب RLHF كسر الشخصية في المواضيع الحساسة مثل العنف المنزلي والاستشارة الطبية أثناء الحمل بالإجابة الآلية “أنا ذكاء اصطناعي”

- المنطق (7.05/10): حل لغز الركن بدرجة 9/10 بتحديد موقع كل سيارة وتعيين أليس بشكل صحيح، وأجاب على سؤال التجاوز “أنت حالياً في المركز الثاني”، لكن فشل في سؤال إخوة ديفيد – استنتج الإجابة الصحيحة (صفر) ثم كتب “واحد” كإجابة نهائية، مما يشير لمشكلة في طبقة الإخراج وليس المنطق

- الرياضيات (8.00/10): تألق في الجبر والحساب النمطي وإيجاد الجذور ومعادلات فييتا، مع نمط خطأ واضح – يكتب رقماً خاطئاً في البداية، يحسب بشكل صحيح، ثم يصحح نفسه. في مسألة مساحة المثلث كتب “المساحة 4” أولاً ثم حسب 3 وصحح، وفي أسعار الكتب كتب “245 دولار” ثم 280 دولار مع التصحيح

- البرمجة (8.44/10): النتيجة المذهلة – أنتج كوداً بجودة الإنتاج بدرجة 8-9/10، استخدم ThreadPoolExecutor للمعالجة المتوازية مع تبرير GIL، اكتشف خطأ None-init TypeError أثناء مراجعة الكود، وتجاوز المطلوب O(n) بحل O(log(min(m,n))) متقدم، بل كتب HTML/CSS/JS كاملاً في تمريرة واحدة وتتبع T(3)=-2 في فيبوناتشي

- الاستخراج (8.60/10): استخرج 39 كلمة من 39 بدرجة 10/10، ونظف بيانات JSON معقدة بدقة عالية، مع انزلاقات طفيفة في التنسيق المحدد لـHTML والاقتباسات

- العلوم والإنسانيات (7.75/10): أجاب على أسئلة الفيزياء والكيمياء والتاريخ بثقة، لكن أخطأ في تفاصيل تاريخية مثل نسب قصيدة صينية لسلالة سونغ بدلاً من تانغ، وفي الاقتصاد خلط بين تأثيرات السياسة النقدية والمالية

المعايرة الحقيقية تظهر أن الفجوة 87 مرة في الحجم لم تمنع التفوق. GPT-4 يسجل 8.99 بتريليوني معامل على أسطول GPU، Gemma 2B + الحراس المقترحة تحقق 8.2 متوقعة على لابتوب بـ4 أنوية. النماذج الأخرى تتطلب GPU بتكلفة 1000-40000 دولار للشراء أو 0.50-5 دولار/ساعة للإيجار، بينما Gemma يعمل على الهاردوير الذي اشتريته لأسباب أخرى.

الحراس الجراحية التي طورها الفريق – ستة إصلاحات بـ60 سطر بايثون لكل منها – تستهدف الأخطاء المحددة: حاسبة للحساب، حلال منطق للألغاز الرسمية، مدقق متطلبات للقيود الهيكلية، وتمريرات regex للتنسيق. هذه ليست إعادة تدريب للنموذج بل حراس في اللحظات التي تتردد فيها طبقة الإخراج.

المفاضلات صادقة: زمن الاستجابة 30-60 ثانية على 4 أنوية مقابل 1-5 ثوانٍ عبر API أوبن إيه آي، الجودة القصوى 8.0 وليس 8.99 لـGPT-4 – استدلال موثوق وليس رائداً، وأنت تدير التبعيات بنفسك. لكن بعد التنزيل الأول 4 جيجابايت، النموذج يعمل دون اتصال للأبد، بلا اشتراك ولا مفتاح API ولا حساب ولا فاتورة شهرية ولا شروط خدمة، ولا أحد يرى بياناتك أو يلغي الأوزان أو يغير ما سيجيب عليه النموذج.

التجربة الفورية متاحة عبر بوت تيليغرام مباشر يعمل بنفس مسار الاستنتاج الذي أنتج كل نقطة في التقرير، أو التثبيت المحلي بثلاثة أوامر: pip install torch transformers accelerate ثم python chat.py. المصدر المفتوح للشريط الكامل والكود والإصلاحات متاح للتحقق والبناء عليه.