بقلم: طارق | محرر السياسات والأعمال · صوت تحريري بإشراف بشري

قررت الحكومة الأمريكية إنهاء سياستها القائمة على عدم التدخل في تطوير الذكاء الاصطناعي، وأعلنت أن المعهد الوطني للمعايير والتكنولوجيا (NIST) سيشكل فرقة عمل متعددة الوكالات لتقييم المخاطر الأمنية الوطنية لنماذج الذكاء الاصطناعي قبل نشرها. وفقاً لـ NIST، ستتولى مجموعة “اختبار مخاطر الذكاء الاصطناعي للأمن القومي” (TRAINS) هذه المهمة تحت إشراف “مركز معايير وابتكار الذكاء الاصطناعي” (CAISI).

تختلف TRAINS عن مجموعات NIST التقليدية في تصميمها للاستجابة السريعة واعتمادها على وزارات التجارة والدفاع والطاقة والأمن الداخلي. وافقت شركات Google وMicrosoft وxAI على تقديم نماذج ذات حواجز حماية محدودة أو غائبة للتقييم، بينما كانت Anthropic وOpenAI قد وافقتا على شروط مماثلة خلال 2024.

هذا التحول الجذري في السياسة الأمريكية جاء بعد شهر واحد من إعلان Anthropic أن نموذجها Claude Mythos Preview يمكنه استغلال نقاط الضعف في البرامج واسعة الاستخدام. إن توقيت هذا القرار ليس مصادفة – فهو يعكس إدراكاً متأخراً لحقيقة أن الذكاء الاصطناعي لم يعد مجرد تجربة تقنية، بل أداة قادرة على التأثير المباشر على الأمن القومي.

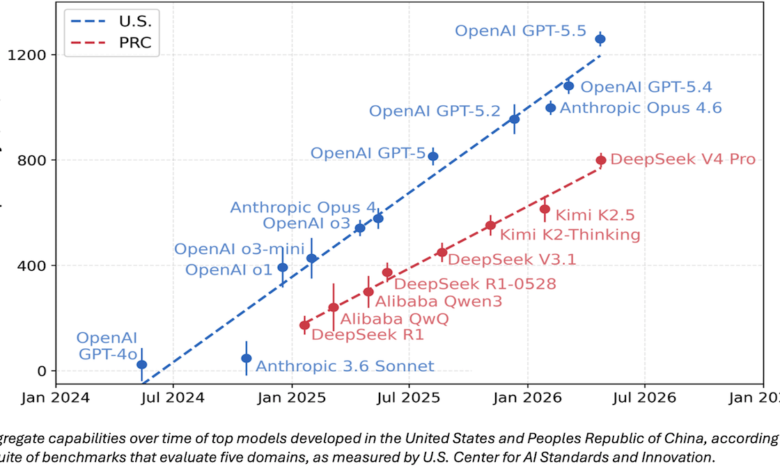

السؤال المحوري الآن ليس ما إذا كان هذا التقييم ضرورياً، بل كيف ستوازن واشنطن بين الأمان والابتكار. الشركات الصينية، التي لا تخضع لمثل هذه القيود التنظيمية، قد تحصل على ميزة زمنية في طرح نماذج جديدة. لكن الجانب الآخر من هذه المعادلة هو أن شهادة السلامة الحكومية قد تصبح ميزة تنافسية في عالم يزداد قلقه من مخاطر الذكاء الاصطناعي.

التحدي الأكبر يكمن في تطبيق هذه السياسة عملياً. كيف ستحدد TRAINS ما يشكل “خطراً أمنياً”؟ وما مدى سرعة عملية التقييم؟ إن بطء البيروقراطية الحكومية قد يخنق دورات التطوير السريعة التي تميز صناعة التكنولوجيا. من ناحية أخرى، إثبات Claude لقدرته على استغلال الثغرات الأمنية يُظهر أن هذه المخاوف ليست نظرية.

الأهم من ذلك هو السؤال عن نطاق هذا التقييم. هل سيشمل جميع النماذج أم فقط تلك التي تتجاوز حداً معيناً من القدرات؟ وهل ستخضع النماذج مفتوحة المصدر لنفس القيود؟ إن تطبيق هذه القواعد على النماذج مفتوحة المصدر قد يدفع التطوير خارج الولايات المتحدة، بينما استثناؤها قد يترك ثغرة أمنية كبيرة.

موجز تعتقد أن هذا التحول في السياسة الأمريكية كان حتمياً، لكن تطبيقه يحتاج توازناً دقيقاً. نحتاج تقييماً سريعاً وموضوعياً يركز على المخاطر الحقيقية، لا على مخاوف مبالغ فيها. إن نجاح هذا النظام سيحدده مدى قدرة الحكومة على تطوير خبرة تقنية حقيقية وتجنب البيروقراطية المعرقلة للابتكار.